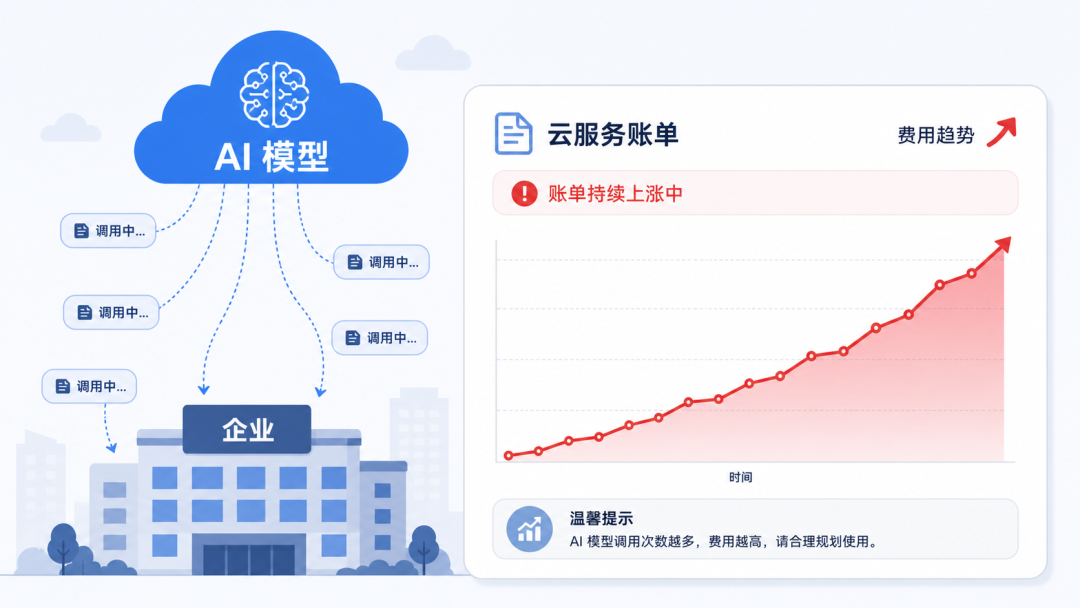

面对大模型付费浪潮,数聚红芯专注企业级大模型本地部署解决方案,支持 Qwen3.6、DeepSeek V4 等最新开源模型私有化部署,搭配高性能 GPU 集群与量化加速技术,为企业量身定制智能客服、知识库问答、代码生成等全场景方案,提供全流程部署运维支持,助力企业实现数据不出内网、成本自主掌控的 AI 能力落地。 关注数聚红芯公众号,对话框发送“方案”,可免费定制专属AI智算解决方案。

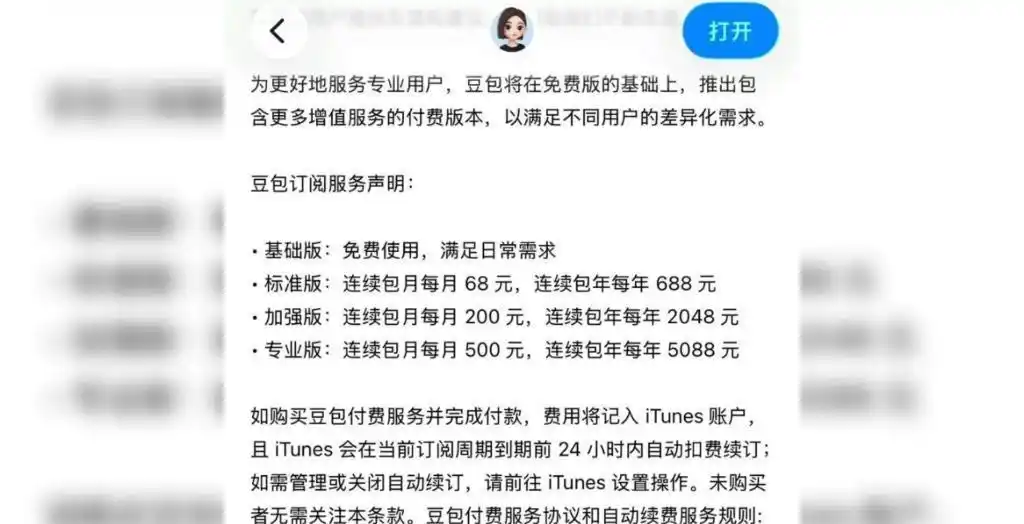

豆包都要收费了,企业使用大模型的终点在哪里?

分类:企业动态

发布时间:2026年05月08日

相关推荐

豆包都要收费了,企业使用大模型的终点在哪里?

2026.05.08

为什么越来越多的企业开始用华为昇腾910B?

2026.05.06

红芯福建首展!联合华为发布鲲鹏AI一体机

2026.04.29

快速落地 DeepSeek V4 模型,仅需 1 台红芯服务器

2026.04.28

DeepSeek V4 发布,红芯 day0 完成适配

2026.04.24

DeepSeek V4 发布,红芯 day0 完成适配

2026.04.12

H200天价一卡难求,华为昇腾910B成性价比国产真替

2026.04.21

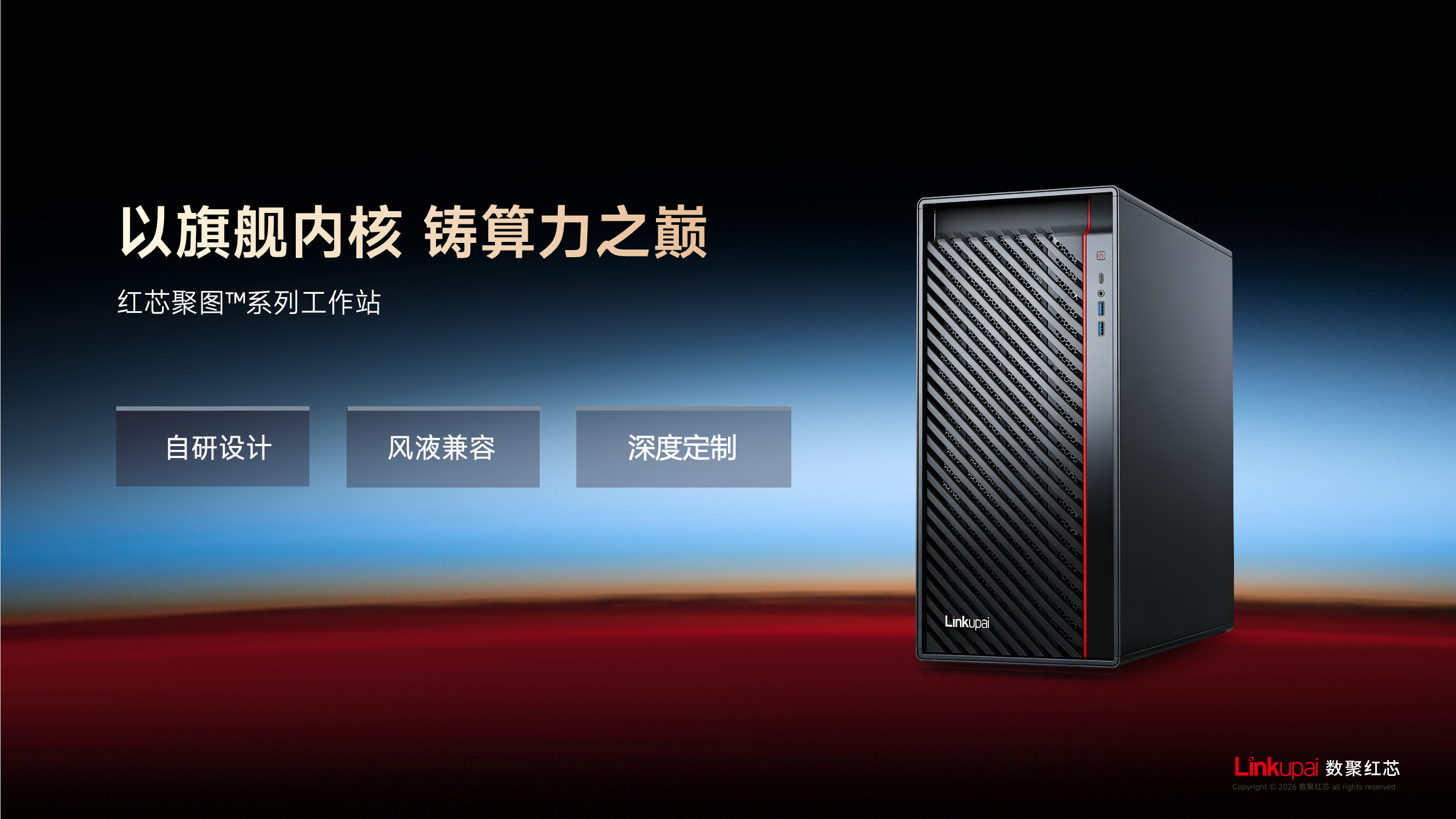

重磅上新红芯聚图™系列工作站,支持深度定制

2026.04.20

红芯聚图™闪耀AMD成都峰会,斩获新锐合作伙伴奖!

2026.04.18