DeepSeek-V4 最新旗舰模型发布 2026年4月24日,深度求索DeepSeek正式发布新一代旗舰级开源大模型 DeepSeek-V4 系列,以百万级超长上下文、开源模型顶级的代码与推理能力,引发全行业的广泛关注。 DeepSeek-V4 系列的发布,标志着国产开源大模型正式迈入了能够与国际顶尖闭源模型正面竞争的阶段:该系列包含 V4-Flash 与 V4-Pro 两个版本,不仅实现了百万级超长上下文的标配能力,更在代码能力、复杂推理、Agent 智能体等企业核心关注的维度上,实现了对国际顶尖闭源模型的赶超。 数聚红芯推出适配解决方案 针对这一痛点,数聚红芯依托多年的 AI 智算落地经验,推出了以DeepSeekV4 W8A8量化版本适配的选型建议:这也是当前企业部署大模型的主流选择,精度损失 < 1%,几乎无感知,可完美兼顾性能与成本。基于标准 8 卡昇腾 910B 服务器(单台总显存 512GB),数聚红芯针对两个版本的模型推出以下配置方案: 中小企业的性价比之选:DeepSeek-V4-Flash 轻量版本 V4-Flash 为高效轻量版本,总参数量 284B,激活参数量 13B,适合大部分中小企业的日常 AI 场景,部署门槛较低: ① 选型配置:仅需 1 台昇腾 910B 服务器即可完成部署,单台服务器即可承载模型权重与推理缓存,可快速落地超长文档处理、常规代码开发、AI 知识库、合同审核、常规业务智能体等场景。 ② 得益于MoE混合专家架构,大幅提升推理速度,降低企业推理算力落地成本。 针对大型企业与科研机构的高端场景,可选择 DeepSeek-V4-Pro 旗舰版本 ① W8A8 量化下推荐2台910C双机一体机,总显存需求 1.6TB,可支撑顶级代码开发、全仓库代码处理、复杂科研计算、高端智能体等场景,帮助企业实现研发效率的跨越式提升。 ② 针对多机部署,需同步配置跨机400G RoCE互联,8*NPU间互联超大带宽784GB/s,满足细粒度专家并行的跨节点通信需求;同时使用统一的昇腾镜像与配套软件栈,搭配分布式共享存储,保障部署效率与推理性能。 全链服务赋能政企数智化转型 数聚红芯专注于AI智能计算解决方案,针对 DeepSeek-V4 模型,能够为政企提供模型的私有化部署,确保数据完全不出内网,满足政府、智能制造、医疗、金融等各行各业的数据安全合规需求。同时通过自主研发的液冷技术大幅降低部署的能耗成本。

相关推荐

DeepSeek V4 发布,红芯 day0 完成适配

2026.04.12

H200天价一卡难求,华为昇腾910B成性价比国产真替

2026.04.12

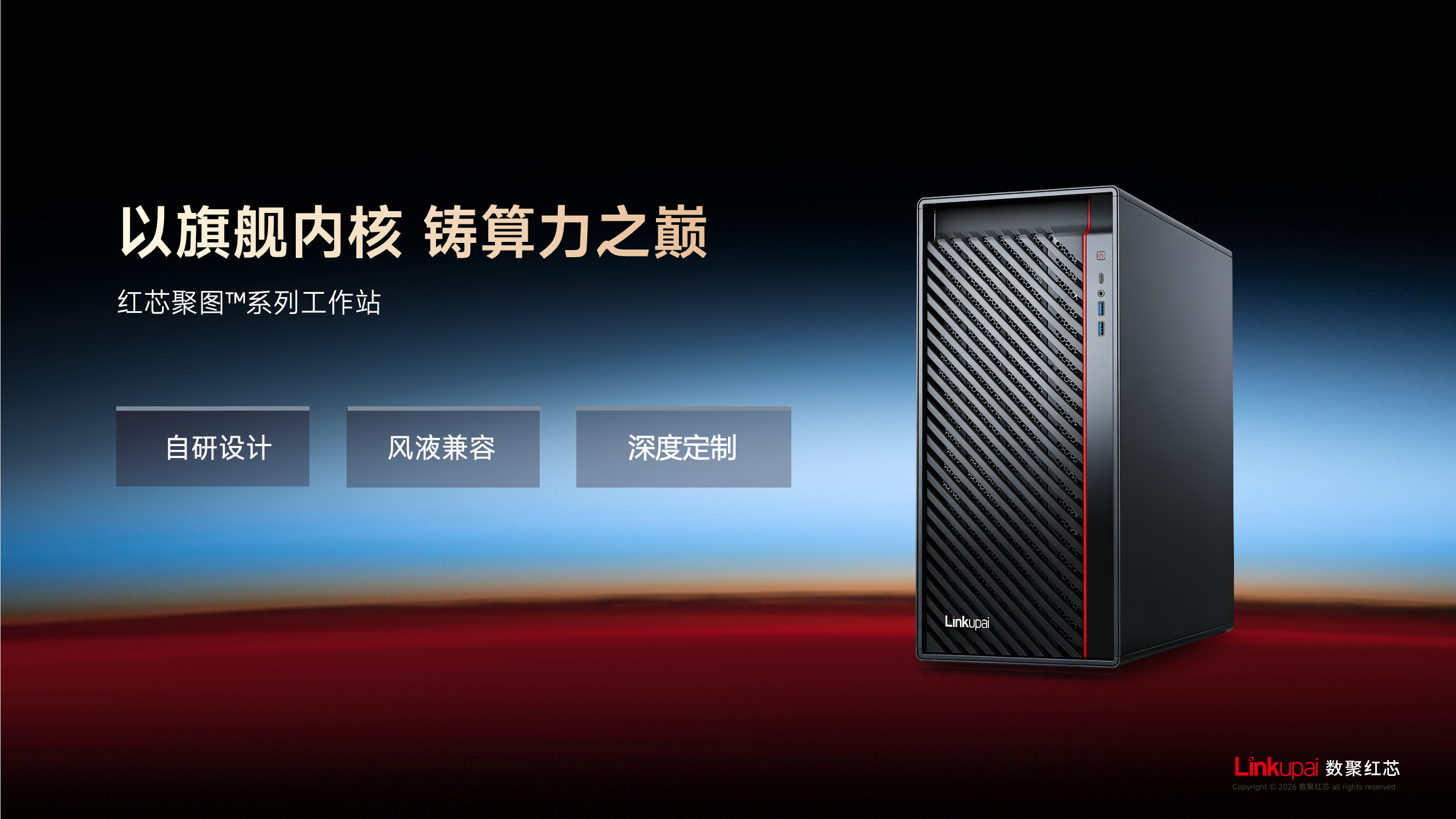

重磅上新红芯聚图™系列工作站,支持深度定制

2026.04.12

红芯聚图™闪耀AMD成都峰会,斩获新锐合作伙伴奖!

2026.04.12

惠创投莅临数聚红芯考察交流,共商算力产业合作新机遇

2026.04.12

荣耀时刻!数聚红芯入榜 AMD 大中华区及亚太地区工作站合作伙伴

2026.04.13

全员AI提效!红芯AI大赛,10大业务场景验证AI真落地

2026.04.18

OpenClaw用的模型越大越好?非也

2026.04.09

豆包算力不足?本地部署,才是AI时代的生产力底线

2026.04.09